L'IA et l'Éthique : Enjeux et Défis d'une Technologie en Pleine Expansion

Entre opportunités technologiques et défis sociétaux

L’intelligence artificielle (IA) a révolutionné de nombreux aspects de notre vie quotidienne, mais elle pose également des questions éthiques complexes. Les biais algorithmiques, la confidentialité des données, l’impact sur l’emploi et la nécessité de cadres juridiques adaptés figurent parmi les principales préoccupations. Cet article explore ces enjeux cruciaux pour mieux comprendre les implications de l’IA dans notre société.

Biais Algorithmiques* : Quand les Préjugés S’invitent dans l’IA

Comment les biais se manifestent

Les biais algorithmiques surviennent lorsque les systèmes d’IA reproduisent ou amplifient des préjugés présents dans les données utilisées pour leur entraînement. Par exemple :

- Une IA de recrutement peut favoriser certains profils en fonction des données historiques biaisées.

- Les systèmes de reconnaissance faciale affichent souvent des taux d’erreur plus élevés pour les personnes issues de minorités.

Pourquoi ces biais sont problématiques

- Discrimination injuste : Les décisions basées sur des biais peuvent nuire à des individus ou des groupes spécifiques.

- Manque de confiance : Ces biais diminuent la crédibilité des systèmes d’IA auprès des utilisateurs.

Solution :

- Pour atténuer les biais, il est crucial de diversifier les jeux de données et d’auditer régulièrement les algorithmes afin d’identifier et de corriger les biais potentiels.

*Biais algorithmiques définition : Ce sont des préjugés ou des discriminations involontaires intégrés dans les systèmes d’intelligence artificielle, souvent dus aux données utilisées pour entraîner ces systèmes. Par exemple, si les données sont biaisées, l’IA risque de reproduire ou d’amplifier ces biais dans ses décisions.

Confidentialité des données : un enjeu crucial

Collecte et utilisation des données personnelles

L’IA repose sur d’énormes volumes de données, souvent personnelles : historiques de navigation, données de santé, géolocalisation, etc. Si ces données alimentent des systèmes puissants, elles peuvent aussi être mal utilisées, compromettant la vie privée.

Par exemple :

- Les assistants virtuels collectent des conversations privées pour améliorer leurs réponses.

- Des applications de reconnaissance faciale surveillent les individus sans leur consentement explicite.

Risques associés

- Vol ou piratage : Les bases de données contenant des informations personnelles peuvent être ciblées par des cyberattaques.

- Utilisations abusives : Les entreprises peuvent exploiter les données à des fins lucratives sans transparence.

Bonnes pratiques pour protéger la confidentialité

- Appliquer les réglementations comme le RGPD (Règlement Général sur la Protection des Données) pour garantir un consentement éclairé.

- Encourager les entreprises à limiter la collecte des données au strict nécessaire.

- Mettre en place des systèmes de chiffrement robustes pour sécuriser les informations sensibles.

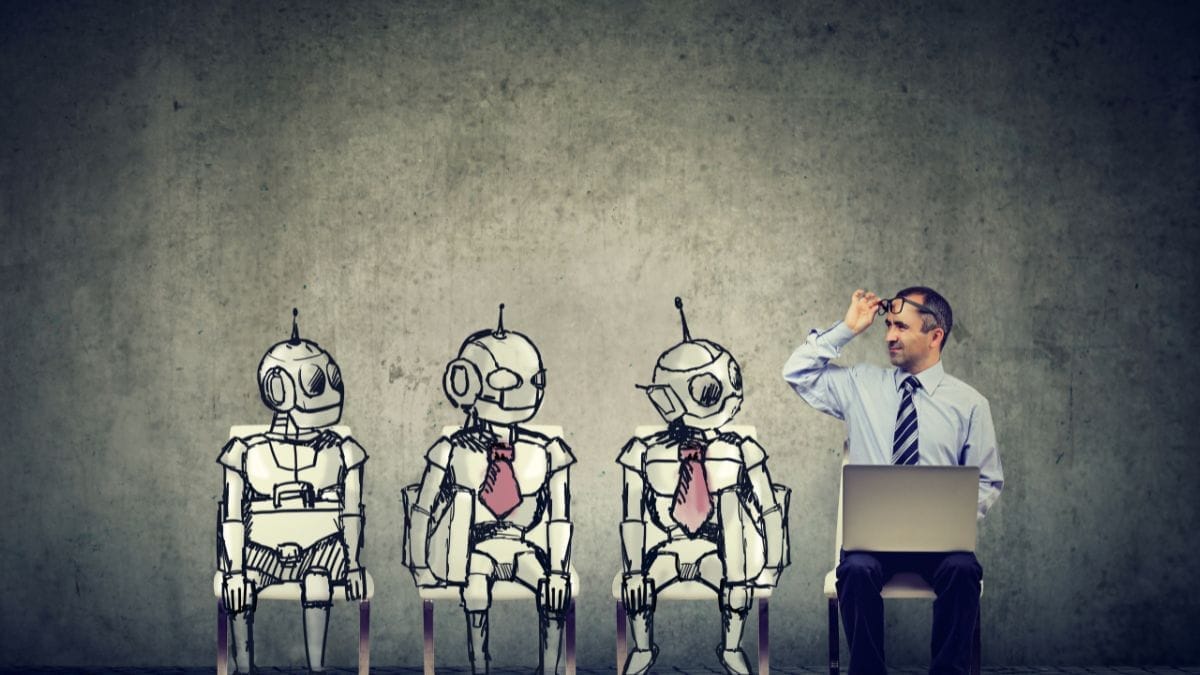

Impact sur l’emploi : entre opportunités et menaces

Automatisation et futur du travail

L’automatisation via l’IA redéfinit le monde du travail. Certaines tâches répétitives ou dangereuses sont désormais réalisées par des machines, ce qui permet d’améliorer la productivité. Cependant, cette évolution peut aussi entraîner des pertes d’emploi.

Secteurs les plus impactés

- Industrie manufacturière : Les robots remplacent les ouvriers dans les chaînes de production.

- Services : Les caisses automatiques ou les chatbots prennent en charge des tâches auparavant réalisées par des humains.

Défis sociaux

- Risque de chômage pour les travailleurs peu qualifiés.

- Creusement des inégalités entre ceux qui maîtrisent les technologies de l’IA et les autres.

Stratégies pour s’adapter

- Formation continue : Proposer des programmes de reconversion pour les métiers impactés par l’automatisation.

- Création de nouveaux emplois : Les innovations liées à l’IA ouvrent aussi des opportunités, notamment dans la maintenance des systèmes ou la gestion des données.

- Dialogue social : Associer les gouvernements, entreprises et syndicats pour anticiper les mutations du marché du travail.

Réglementations et lois : un cadre nécessaire

Cadres juridiques en place et nécessaires

Les gouvernements et organisations internationales commencent à mettre en place des lois pour encadrer l’utilisation de l’IA.

Exemples de réglementations existantes

- Le RGPD en Europe : Protège les données personnelles et impose des obligations de transparence aux entreprises utilisant des algorithmes.

- Régulation de la reconnaissance faciale : Certains pays, comme la France ou les États-Unis, restreignent l’usage de cette technologie dans les lieux publics.

Besoins pour l’avenir

- Développer des normes éthiques globales pour encadrer l’IA, avec des sanctions pour les abus.

- Créer des agences de contrôle indépendantes pour surveiller les applications de l’IA.

- Clarifier les responsabilités juridiques en cas d’erreurs ou de préjudices causés par l’IA.

Conclusion : vers une IA éthique et responsable

L’éthique de l’intelligence artificielle est un défi majeur du XXIe siècle. Les biais algorithmiques, la confidentialité des données, l’impact sur l’emploi et les lacunes réglementaires nécessitent une attention prioritaire. Construire une IA respectueuse des valeurs humaines exige des efforts conjoints des gouvernements, des entreprises et des citoyens.

En anticipant ces enjeux, nous pouvons exploiter le potentiel de l’IA tout en minimisant ses risques.